Open-Source LLMs.

Hosted in Europa.

tokeneurope.ai bietet leistungsstarke Large Language Modelle auf ISO-zertifizierter Infrastruktur in Österreich

Open Source statt Blackbox

Wir betreiben die leistungsstärksten Open-Source-LLMs (z. B. GPT-OSS, Mistral, Gemma, Qwen) auf Österreichischer Infrastruktur. Keine API-Umwege, keine Datentransfers in Drittstaaten. Maximal Transparenz.

Europäische Datensouveränität

Hosting ausschließlich in österreichischen Rechenzentren nach höchsten europäischen Sicherheitsstandards (ISO 27001, EN50600). AI-Act-konforme Dokumentation inklusive.

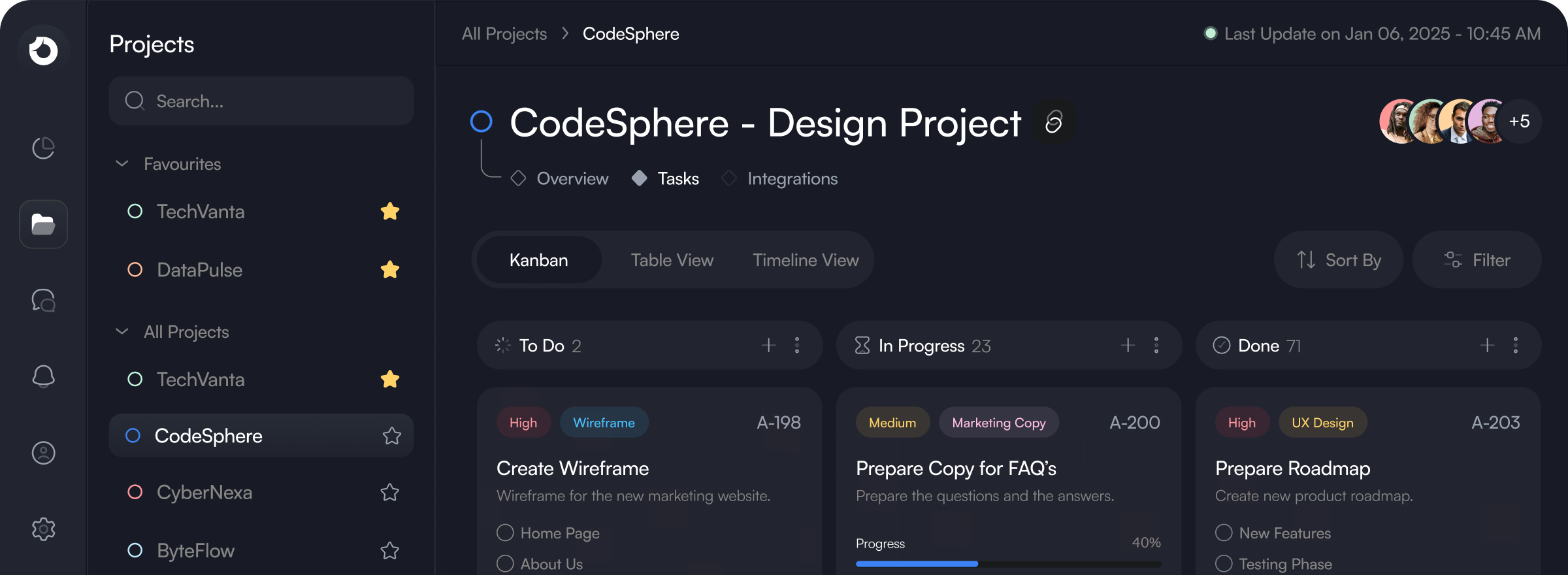

API-kompatibel & flexibel

Drop-in Replacement für OpenAI-oder Ollama-APIs - keine Downtime.Kompatibel mit LangChain,LlamaIndex, vLLM u. a.

Bereit für Enterprise & Forschung

Skalierbare Nutzung - von PoC bis Hochverfügbarkeit passen sich unsere Modelle an eure Bedürfnisse an.

Deine Use Cases rund um unsere LLMs

Token-Preise –

Fair & transparent

Bei uns wird nur das abgerechnet, was auch tatsächlich verbraucht wurde - keine versteckten Kosten & berechenbar! Individuelle Angebote und gesicherter Throughput sind auf Anfrage gerne verfügbar.

Monatliche Zugangsgebühr € 50.-- inkl. 1 Million Token.

Sicherheit, die man belegen kann

Infrastruktur

Höchste Sicherheitsstandards: Cloud-Hosting in ISO 27001- und EN 50600-zertifizierten europäischen Rechenzentren ohne Datenverkehr außerhalb Europas.

AI Act Support

Wir können auf Anfrage vollständige technische Dokumentationen, Risiko-Reports und Model Cards zur Integration in AI-Act-Compliance-Prozesse liefern.

Transparenz

Zugriff auf Model Weights und Audit-Berichte nach Vereinbarung.

Easy to use und drop-in replacement für ChatGPT, Gemini & Claude

REST-API mit OpenAI-kompatiblen Endpunkten, als direkter Ersatz für OpenAI- oder OllamaAPIs. SDKs für Python, Node.js, Go, Rust, etc.

Lasst uns über souveräne KI sprechen

Wir beraten euch gerne zu Hosting, Integration und Compliance-Themen mit tokeneurope.ai.